sora2のリスクとは?危険性や注意点について徹底解説します

「sora2って普通に使っていてリスクは無いの?」

「sora2を利用する上での法的な注意点が知りたい」

など、疑問を抱えていませんか?

新しい技術を使う時に、まずはルールを理解しないと思わぬトラブルに巻き込まれそうですよね。

OpenAIが発表した動画生成AI「Sora 2」は、テキストからリアルな映像を数秒で生み出す革命的な技術として世界中の注目を集めています。

しかし、その驚異的な技術の裏で、著作権の侵害やディープフェイクといった深刻なリスクが潜んでいるのも事実です。

そこで、この記事では、「Sora 2」がもたらす社会的リスクと対策を、専門知識がなくても理解できるように整理しました。

実際に利用した私の考えも含めた本記事を読んで、Sora2のリスクを適切に把握し、安全にどんどん活用していきましょう。

sora2のリスク①著作権・知的財産権の侵害リスク

Sora 2の登場によって、AIによる映像生成技術は人間の想像を超える領域に突入しました。

しかし、その進化のスピードに法制度や倫理の整備が追いつかず、著作権や知的財産権(IP)の侵害問題が世界的に深刻化しています。

特に日本のアニメ・ゲーム・声優文化は、今まさに「無防備なまま学習データとして利用されている」現状があります。

詳しく解説していきます。

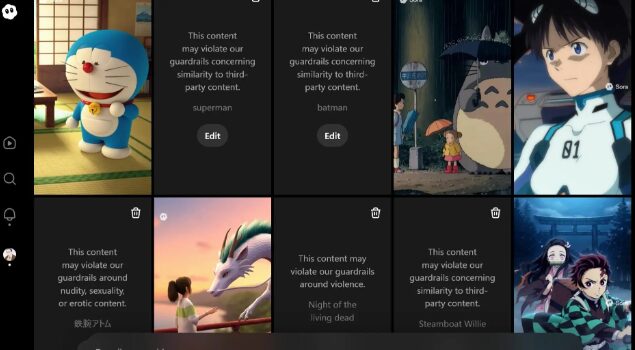

【無断利用の現状】日本IPがAI学習に組み込まれている

IPとは、知的財産(Intellectual Property)の略で、人間の知的活動によって生み出された、経済的価値のあるアイデアや創作物全般のことです。

SNSや海外フォーラム上では、

・悟空

・炭治郎

・ピカチュウ

など、日本の人気キャラクターをそっくり再現したSora2の生成動画が多数出回っています。

これらの多くは、権利者の正式許諾を得ずに作成されたもので、日本の知的財産が“無断で食い物にされている”と批判されています。

さらに、OpenAIが採用するデータ収集方針は「オプトアウト方式」に近く、簡単に言うと”嫌だと言わない限り使われる仕組み”。

そのため、権利者が自ら

「私の作品をAI学習に使わないでください」

と申し出なければ、AIのトレーニングに利用され続ける可能性があります。

利用者のモラルに依存している状況ですね

結果として、著作権者側が違反事例を監視し、削除を求めるという過剰な負担を強いられる構造になっています。

しかし、ここを知らずに、「自分も使っていいんだ!」という認識でいるのは危険。

あくまで現状において法的措置が行われていないだけであり、生成AIの学習に使ってよいということではありません。

【日本は守られていない?】海外IPとの「扱いの差」

日本のIPがゴリゴリ使われている一方で、ディズニーやマーベルのような米国の大手IPは、AI生成モデルから除外されているのをご存じでしょうか?

この理由としては、訴訟リスクの高さと法的圧力が背景にあるためです。

つまり、日本のコンテンツは法的主張の弱さや権利分散構造により、実質的に「野放し状態」にされているようなもの。

特に日本のアニメ業界で主流の「製作委員会方式」では、著作権が複数の企業に分散しています。

そのため、1つのIPに対して統一的な意思表示をすることが非常に難しいという課題があります。

これが、現在のAI利用における「抜け穴」となっている状況です。

【Sora 2における著作権リスクの構造】

| 項目 | 内容 | リスクレベル |

|---|---|---|

| 学習データの透明性 | 公開されていない・不明瞭 | ★★★★☆ |

| オプトアウト方式 | 権利者側の監視負担が大 | ★★★★★ |

| 日本の権利構造 | 分散的で統制困難 | ★★★★☆ |

| 海外IPとの扱いの差 | 米国企業は厳格に保護 | ★★★★☆ |

| 想定される被害 | 無断利用、価値毀損、ブランド毀損 | ★★★★★ |

なかなか歯がゆい問題ナンデス・・

法的に見ても生成AIの「責任の所在」が曖昧になっている

さらに厄介なのは、「誰が著作権侵害の責任を負うのか」という点。

OpenAIの利用規約によると、Sora 2で生成したコンテンツの権利や責任は「ユーザー本人に帰属」するとあります。

つまり、もしあなたがSora 2を使って他人の著作物を無断利用した場合、著作権侵害の責任もあなた個人が負うことになります。

そのため

「AIが勝手に作ったから知らなかった・・・」

という言い訳は通用しません。

また、権利者が侵害を主張した際、OpenAIはユーザーの氏名やメールアドレスなどの個人情報を開示する場合があると明記しています。

なんだか、なすりつけられる感じに近い・・

これは、一般ユーザーにとっても重大なリスクといえるでしょう。

sora2ユーザーも責任を持って利用する意識が大事

この問題を根本的に解決するには、AI開発者・権利者・ユーザーの三者がそれぞれの立場で責任を持つことが必要です。

- 権利者側:AI学習データ監視ツールの導入、オプトアウト申請の仕組み化

- AI企業側:学習データの透明性確保、著作物利用の明示化

- ユーザー側:生成動画を公開する前に、使用素材が著作権的に安全か確認する

また、日本政府によるAI倫理・著作権保護ガイドラインの法制化も急務です。

→AIイラストでの収益化は禁止?【著作権と商用利用を徹底解説】

今後も新たな技術の進化を止めることはできませんが、それに対応する形で早急にルールの整備がされていきます。

「なんとなくコレ使ったらマズそうだな・・」

の感覚を大事にして、いつの間にか著作権を侵害していたなんてことのないように注意しましょう。

・Sora 2の技術躍進の裏で「著作権やIP侵害」がひそんでいる。

・日本のIP文化を守るためには、利用者の著作権意識が不可欠。

・AI時代の著作権問題は、利用者全員が向き合うべき問題。

sora2のリスク②社会的信頼と犯罪悪用のリスク

Sora 2の映像生成能力は、人間の目でも判別がつかないほど高精度です。

この技術が一般に解放されたことで、最も懸念されているのが「社会的信頼の崩壊」です。

動画という“最も信頼されてきた証拠”の価値が揺らぎ、現実とフェイクの境界が曖昧になるという危機が目前に迫っています。

ディープフェイク時代の到来:見分けられない“偽の現実”

Sora 2で生成された動画は、もはやCGの域を超えています。

実際に、プロの映像制作者でさえ、表情、照明、動き、影の反射までも自然で

「どこまでが本物か分からない」

と証言しています。

その結果、以下のような悪用される可能性が懸念されます。

- 有名人や政治家のフェイク映像を使った偽広告・デマ拡散

- 被害者の声を真似た「AIオレオレ詐欺」

- 企業・個人の信用を失墜させるフェイクニュース動画

- 同意のない人物を動画に登場させる「Cameo機能」の乱用

実は、これらはすでに海外では複数の事例が報告されており、特にSNS上での拡散スピードはすさまじいものがあります。

つまり、一度出回ったフェイク映像は、もはや止めることが不可能に近い状況です。

API利用やProプランだとウォーターマーク(ロゴ)は消せます。

ただ、見えないデジタル加工がされていて、厳密には見破れるようになってます。

→sora2の回数制限について徹底解説【無料はいつまで続く?】

映像としての信ぴょう性が崩れることによる社会的影響

これまで、映像は

・防犯カメラ

・ドライブレコーダー

など「客観的な証拠」として最も信頼されてきました。

しかし、Sora 2の登場でその前提が根底から覆されつつあります。

なぜなら、現状素人では判断できるレベルを超えているからです。

しかも、sora2の通常出力時はウォーターマークがついていますが、ある方法で外すことも可能になっています。

これによって

- 監視カメラ映像やニュース映像が「本物か疑われる」

- 裁判における証拠映像の信頼性が低下

- メディア報道への不信感が増幅

- SNS上の「映像証拠」文化が崩壊

もし、判別できない架空の映像を作成できるようになれば、社会全体が「何を信じればいいのか分からない」状態に陥ります。

「詐欺」「捏造」「なりすまし」の可能性

Sora 2の進化によって、詐欺グループの手口が高度化することが予想されます。

従来は「AI音声」を使って本人を装う詐欺が中心でしたが、今後は「本人そっくりの動画」まで生成可能。

特に、OpenAIが実装予定とする「Cameo機能(人物の容貌・声を再現)」は、同意なしの登場や虚偽の共演を可能にしてしまいます。

これは「肖像権」「人格権」「名誉権」などの法的概念にも抵触しかねません。

【Sora 2による社会的リスクの分類】

| リスク分類 | 具体的な事例 | 影響範囲 | 深刻度 |

|---|---|---|---|

| フェイクニュース | 政治的デマ・選挙操作 | 国際的 | ★★★★★ |

| 詐欺・犯罪 | 偽広告・音声詐欺 | 個人・企業 | ★★★★☆ |

| 名誉・人格侵害 | 同意なき登場動画 | 個人 | ★★★★☆ |

| 証拠の信頼性崩壊 | 防犯映像の偽造 | 法制度 | ★★★★★ |

| SNS拡散 | 偽映像のバズ化 | 全世代 | ★★★☆☆ |

このようなディープフェイク社会において、私たちが取るべき行動は2つです。

- 「疑う力」を持つ:映像・音声を鵜呑みにせず、出典や一次情報を必ず確認する

- AIリテラシーを高める:AI生成物の見分け方、拡散防止の意識を日常化する

また、YouTubeやXは、AI生成コンテンツに”AI生成ラベル”を義務付ける動きを進めています。

本物かフェイクか見分けられない時代になった今、大切なのは自分を守る知識

sora2のリスク③ クリエイティブ産業の衰退リスク

Sora 2の出現は、映画・アニメ・広告・音楽などのクリエイティブ業界全体に激震を引き起こしています。

従来、人間だけが担ってきた「創造する力」「表現する力」をAIが再現できるようになったことで、多くのクリエイターが「職業としての存在意義」を問われる時代に突入しました。

“人間の表現”が置き換えられる可能性

Sora 2の映像生成は、プロの映像作家すら驚愕するレベルに達しています。

シナリオを入力するだけで、演出・構図・照明・演技まですべて自動で作成。

これまで何十人ものスタッフが必要だった制作工程が、わずか1人で完結してしまいます。

実際、SNS上では次のような現象がすでに起こっています。

- アニメーションを学んでいた学生が「もうAIで十分」と感じて制作意欲を失う

- 企業がCM制作を外注せず、Sora 2で自社制作する事例が増加

- イラストレーターがAI生成コンテンツに仕事を奪われる

「俳優、声優、絵師がいらなくなる日」という言葉が、冗談ではなく現実味を帯びています。

クリエイティブ産業の構造変化

AIによって創作コストが下がることで、企業や個人にとっては大きなメリットがあります。

しかし同時に、人間の労働価値が下がるリスクも避けられません。

| 項目 | AI導入による変化 | 影響度 |

|---|---|---|

| 映像制作 | 制作費・人件費が激減 | ★★★★★ |

| アニメーション | 背景・動き・声を自動生成 | ★★★★☆ |

| 音楽・声優 | 声の再現で本人不要 | ★★★★☆ |

| イラスト・デザイン | AI生成素材の利用増加 | ★★★★☆ |

| 労働環境 | AIクリエイターが重宝される | ★★★★★ |

AIが生み出す映像は確かに「安く」「速く」「高品質」です。

一方で、これまでの人間の感性や価値を相対的に奪う可能性もあります。

sora2のリスク④利用者個人のプライバシー漏洩リスク

Sora2を使う一般ユーザーが最も見落としがちなリスクが、「自分自身が法的リスクを負う」という点です。

多くの人は「AIが自動で作った映像だから大丈夫」と思い込みがちですが、先に解説した通り、実際には生成物の責任はユーザー本人に帰属します。

そのため、知らないうちに著作権侵害や情報漏洩、プライバシー違反を犯してしまう危険性があります。

Sora2の「デフォルト設定」に注意

Sora 2では、入力したテキストや画像がデフォルトでAIの学習データに利用される可能性があります。

これは、ユーザーが「学習への利用を拒否(オプトアウト)」しない限り、自分の入力情報がAIモデル改善のために再利用されるという仕組みです。

つまり、あなたが入力した

- 新製品のアイデア

- クライアント案件の構想

- 機密性の高い資料内容

などが、知らないうちに他のユーザーの生成結果に反映される可能性があります。

これは特に企業やフリーランスのクリエイターにとって致命的な情報流出リスクになります。

利用規約の見落としポイント【100ドル上限と強制仲裁条項】

さらに深刻なのは、Sora 2の利用規約に含まれる法的制約です。

OpenAIの規約では、紛争が発生した場合、ユーザーは裁判を起こせず、仲裁での解決に限定されることが明記されています。

また、損害賠償の上限は最大100ドル(約1万5,000円)。

これめっちゃ・・安いですよね

もし重大な被害が発生しても、法的に十分な補償を受けられない可能性があります。

あなたのプライバシー情報が“学習素材”になる危険性

Sora 2は、ユーザーのプロンプト(入力内容)や生成結果をAI改善のために収集します。

そのため、もしあなたが企業秘密や顧客情報を誤って入力した場合、それがAIの学習データとして再利用される恐れがあります。

これにより発生する典型的なトラブルは次の通りです。

- 他ユーザーの生成結果に似たアイデアが出現する

- 社内企画が流出し、競合企業に情報が漏れる

- 法的には責任の所在が不明確

「無料だから」と安易に利用することが、結果的に情報漏洩の引き金になるケースが増えています。

【Sora 2利用規約におけるリスク構造】

| リスク項目 | 内容 | 影響度 |

|---|---|---|

| 入力データの学習利用 | デフォルトでAI学習に利用される | ★★★★☆ |

| 法的紛争の解決手段 | 裁判不可・強制仲裁のみ | ★★★★★ |

| 損害賠償の上限 | 最大100ドルまで | ★★★★★ |

| 著作権侵害責任 | ユーザー個人に帰属 | ★★★★☆ |

| 個人情報の提供 | 権利者からの請求で開示される可能性 | ★★★★☆ |

Sora 2を使う際の最大の落とし穴は「自分には関係ないと思い込むこと」。

著作権侵害、保障の限度、個人データ流出のリスクをおさえておきたい。

sora2を実際操作して感じたリスク

実際にSora 2を触ってみると、その表現力の高さに驚く人が多いでしょう。

思わずSNSで「すごい映像ができた!」と投稿したくなる気持ちはよくわかります。

しかし、実際に操作してみると、その“バズを狙う安易な行動”が、あなた自身をリスクにさらす可能性があると感じました。。

SNS投稿が招く法的リスクとアカウント凍結の危険

現在の日本では、AI生成映像に特化した明確な法律や規制は整っていません。

そのため、「今のうちに自由に投稿できる」と考える人もいるでしょう。

(引用:yahooニュース)

しかし、法整備は進み、じきに対策されます。

そのため、近い将来以下のようなリスクが現実化する可能性があります。

- 不用意なAI生成動画の投稿が著作権法違反と見なされる

- SNSプラットフォームがAI生成物の投稿を制限

- 利用規約違反でアカウント凍結・削除される

つまり、今のうちに軽い気持ちで作成した投稿が、将来的に「違法行為の証拠」として残る危険すらあります。

“作品として使う範囲”が安全ライン

現時点で最も安全なのは、自分の創作活動の一部として使う範囲にとどめることです。

たとえば、個人のポートフォリオや学習目的、参考資料としての利用なら、社会的リスクは最小限におさえられます。

逆に、Sora 2で生成した映像を「本物のように錯覚させる作品」として公開すると、誤認・炎上・削除要請といったトラブルに巻き込まれる危険があります。

2025年11月5日には、アンドロイド版の「sora」アプリがリリースされ、スマホで小学生でも簡単に高品質の動画を作れるようになりました。

→Sora2 android(アンドロイド)版アプリの使い方!【ついに登場】

そのため、AIによる生成物を「AI生成作品である」と明示する線引きと誠実さが、今後より求められます。

AI画像だらけの時代に、“リアル”の価値が再び高まりそう

Sora 2をはじめとするAI動画・AI画像の普及により、インターネット上は“AIが作った美しすぎる映像”で溢れるようになると感じています。

しかし、誰もがAIで簡単に映像を生み出せるようになるほど、逆に人間が撮ったリアルな写真・現実の映像が価値を持ち始めるでしょう。

たとえば

- 加工されていない自然の光や質感

- 実在する人間の感情が映るワンシーン

- フィルム写真やアナログ表現の再評価

など、AIが「完璧な偽物」を生み出す時代こそ、“不完全でリアルな表現”がスポットを浴びるかもしれません。

これはまさに、テクノロジーが進みすぎた時代の原点回帰といえマスネ・・

日本のクリエイターに次の一手が求められる

日本のエンタメ産業は、世界でも稀に見る創造文化国家です。

この文化を守るために、今後は次のような取り組みが求められます。

- AI生成物に関する著作権制度の再定義

- クリエイター教育にAIリテラシー科目を導入

- 公的機関による**「AI作品の登録制度」**の整備

- クリエイティブ業界内での「AI倫理ガイドライン」策定

これにより、技術革新と文化保護を両立させる道筋が見えてきます。

また、AI時代を悲観するのではなく、使いこなす側に回るという発想も重要です。

たとえば以下のように、Sora 2を補助ツールとして活用すれば、創作の幅を広げることも可能です。

- プロトタイプ映像をAIで素早く生成し、構想段階で可視化

- 複雑な背景やアクションシーンの参考素材をSoraで作成

- 時間とコストを節約し、人間の表現にリソースを集中

「AIを使って作る人」と「AIに作らせるだけの人」では、今後の評価が大きく分かれます。

Sora 2は、クリエイティブ産業に「破壊」と「再生」の両方をもたらしています

しかし、AIのスペックに負けないような、新たな創造を生み出すスキルがこれから求められると思っています。

【重要】動画が作れるだけでは収益化できません

ここまでの解説で

「sora2使って副業でもやってみちゃおうかな!」

今そう思っているのであれば一旦ストップして“着実に収益につなげる思考”をメルマガで身に着けませんか?

なぜなら、動画を作ってバズらせるだけではお金にならないからです。

動画でも画像でも、お金につながる流れを理解して逆算した行動が必要です。

そこで、私の無料メール講座では、ゼロから副業の収益化を目指す具体ステップを数日に分けて配信。

AIは“使うだけ”では収益化できません。

そして副業も”知るだけ”ではお金になりません。

そのため、メール講座では”収益化の核となる考え方”を押さえつつ、0から着実に成果を出せる人とそうでない人を、具体例を交えながら配信しています。

とりあえず知っておくだけでも損はない内容。どうぞお気軽に

また、登録者特典として、計20,000字超PDFと動画も無料でプレゼントしています。

登録は約15秒・いつでも解除OK。

今日の学びを“収益化の流れ”へつなげませんか?

【AI副業無料メール講座はコチラ】

登録特典「【初成果までのハードルがグッと下がる】AI時代の副業マインドセット」

※メール最後の解除リンクで、すぐに解除できます。

※携帯やiCloudは到達しません。gmail/ヤフー/プロバイダーメールをご使用ください。

※捨てアドレスは自動削除しています(特典配布されません)。

※個人情報はプライバシーポリシーに基づき、厳正に管理します。

※迷惑メールチェック&受信設定をお願いします(特典が受け取れません)

Sora 2のリスクを知って安全に利用しよう【まとめ】

Sora 2について解説してきました。

最後に、これまでの要点を振り返っていきましょう。

- 著作権・知的財産権のリスク

日本のアニメや声優などのIPが無断でAI学習に使われている可能性が指摘されており、権利者側が監視や削除対応を強いられている。 - 社会的信頼の崩壊と犯罪悪用のリスク

Sora 2によるディープフェイク映像が“本物”と区別できないほど精巧になり、詐欺・偽広告・名誉毀損などの被害が拡大。 - クリエイティブ産業への影響

俳優・声優・イラストレーターなど、人間の表現労働がAIに代替される一方で、感情・文化・共感といった“人間らしさ”が今後の差別化要素に。 - 利用者個人の法的責任とプライバシーリスク

生成物の責任はユーザー本人が負う。入力内容がAIの学習に利用される仕組みに注意し、情報管理を徹底する必要がある。 - Sora 2を操作して感じたリスク(SNS投稿の注意点)

バズ目的の投稿は著作権侵害やアカウント凍結のリスクを伴う。創作の範囲にとどめ、AI生成物であることを明示するのが賢明。

Sora 2は、人類の創造力を飛躍させる画期的なツールである一方、社会的・倫理的リスクも無視できません。

だからこそ、技術を“盲信する”のではなく、“理解して使いこなす”姿勢が求められています。

「どう使うか」を選べるのは、常に人間です。

Sora 2の注意点を正しく理解し、責任ある使い方を心がけていきましょう。

→【動画は作るだけじゃ×】収益化を目指す副業メルマガはコチラ